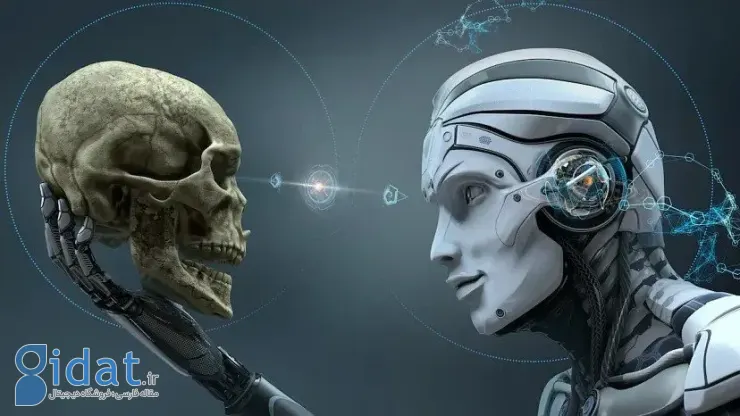

توسعه بی قاعده و عدم نظارت بر هوش مصنوعی میتواند فاجعهبار باشد.

تعدادی از سرشناسترین دانشمندان هوش مصنوعی در مورد ریسکهای این فناوری هشدار داده و اعلام کردهاند که باید برای خطرات فاجعهبار هوش مصنوعی که ممکن است هر لحظه رخ دهد، آماده باشیم.

طبق بیانیه کنسرسیوم گفتگوهای بینالمللی در مورد ایمنی هوش مصنوعی (IDAIS) در همایشی در ونیز، پیشرفتهای سریع صورتگرفته در حوزه هوش مصنوعی بشریت را به سمتی میبرد که در آن هوش مصنوعی با هوش انسان برابر میشود یا حتی از آن پیشی میگیرد. هدف از برگزاری این همایش، اعلام هشدار در مورد خطرات هوش مصنوعی و نحوه کاهش این خطرها بود.

در این همایش برخی از دانشمندان سرشناس هوش مصنوعی ازجمله «جفری هینتون»، متخصص مؤسسه تورینگ، و «ژانگ یا کین»، رئیس سابق شرکت چینی بایدو، حضور یافته بودند. در پایان نیز بیانیه این نشست در مورد خطرات هوش مصنوعی توسط حاضرین به امضا رسید.

در بیانیه IDAIS ذکر شده است که ازدستدادن کنترل انسانی یا استفاده بدخواهانه از سیستمهای هوش مصنوعی که در چند دهه آینده عرضه میشوند و بسیاری از آنها نیز هماکنون عرضه شدهاند میتواند نتایج فاجعهباری برای تمام بشریت به دنبال داشته باشد.

هدف از بیانیه نشست IDAIS ترسیم خطر هوش مصنوعی برای جهان و همسو کردن آن برای مقاصد خوب و سودمند اعلام شده است. در طی این نشست، دهها کارشناس حوزه هوش مصنوعی گرد هم آمدند تا در مورد خطرات این فناوری که بهسرعت نیز توسعه مییابد هشدار دهند.

امضاکنندگان بیانیه IDAIS همچنین اعلام کردند درحالیکه گامهای اولیه امیدوارکنندهای از سوی جامعه بینالمللی به سمت همکاری در حوزه ایمنی هوش مصنوعی در اجلاسهای بیندولتی برداشته شده است، اما این تلاشها باید روی توسعه یک «طرح اضطراری جهانی» برای زمانی که خطرات هوش مصنوعی شدیدتر شد متمرکز شود.

چنین طرحهای اضطراری میتواند شامل تأسیس یک نهاد بینالمللی برای ایجاد آمادگی در شرایط اضطراری باشد. همچنین به یک اجماع متقابل در مورد «خطوط قرمز» و آنچه در صورت ردکردن این خطوط قرمز توسط افراد و نهادها باید صورت بگیرد، نیاز است.

پاسخ ها